DeepSeek开源LPLB负载均衡器:线性规划优化MoE模型训练GPU效率

DeepSeek开源LPLB负载均衡器:线性规划技术优化MoE模型GPU训练效率

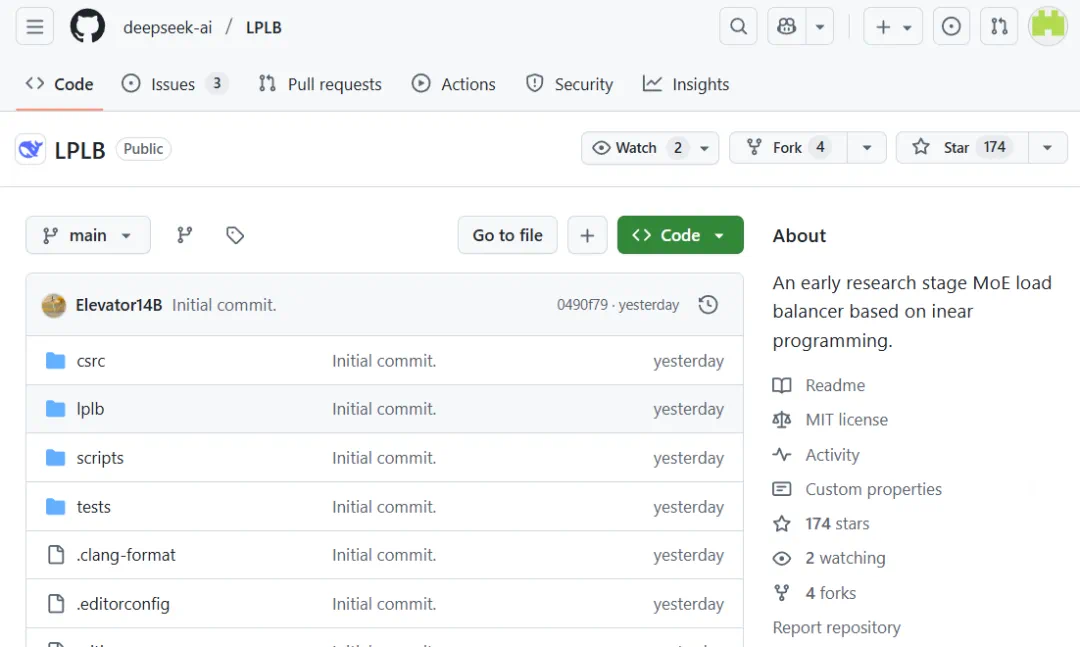

近日,人工智能研究机构DeepSeek在GitHub平台悄然发布了一个名为LPLB的创新项目。尽管该项目尚未通过官方社交媒体渠道广泛宣传,且目前获得的关注度有限(star数量不足200),但其技术内涵却颇具深度。

项目地址:https://github.com/deepseek-ai/LPLB

技术社区对此反应积极,有专家分析认为这标志着DeepSeek正在着力解决模型训练中的正确性和吞吐量瓶颈,为下一代模型的发布进行技术储备。

技术核心解析

LPLB(基于线性规划的负载均衡器)是一个专门针对混合专家(MoE)模型设计的并行负载均衡解决方案。该技术运用线性规划算法,对专家并行训练过程中的工作负载分配进行智能化优化。

系统实现动态负载均衡的关键步骤包括:

- 智能重排序:依据实时工作负载统计数据对专家进行动态排序

- 副本构建:基于预设拓扑结构创建专家副本

- 最优分配求解:针对每个训练批次数据,计算最优的Token分配策略

在技术实现层面,LPLB借助EPLB完成专家重排序过程,工作负载信息可通过多种渠道获取,包括用户自定义输入、torch.distributed收集或Deep-EP缓冲区的内部通信机制。系统内置的线性规划求解器采用单SM内点法,并充分利用NVIDIA的cuSolverDx和cuBLASDx库进行高效线性代数运算。

这一设计有效解决了MoE模型中常见的负载不均衡问题——即某些专家处理过多Token而导致部分GPU过载、其他GPU闲置的状况。

需要特别说明的是,该项目目前仍处于早期研究阶段。DeepSeek在项目文档中明确表示,LPLB的性能改进效果仍在持续评估中。

技术架构深度剖析

LPLB作为EPLB(专家并行负载均衡器)的功能扩展,专门应对MoE训练过程中的动态负载波动问题。

技术定位差异

- EPLB:主要解决静态不均衡问题,如因数据分布特性导致的专家长期过载

- LPLB:专注处理动态波动,应对训练过程中小批次数据随机性引发的瞬时负载变化

核心运行机制

- 冗余专家设计:每个冗余专家副本与原始专家建立连接,在GPU间构建网络边

- 边容量控制:定义单条边可承载的最大Token数量,限制负载平衡流量

- 线性规划优化:在边容量约束条件下,通过线性规划算法重新分配Token,最小化专家并行组内的负载差异

实现流程优化

- 通过EPLB智能选择需要复制的专家(仅排序,暂不复制)

- 基于选定拓扑结构复制负载最重的专家

- 通信优化:采用NVLINK和NVSHMEM技术替代传统的torch.distributed.allreduce,显著降低通信开销(这也是需要预装DeepEP的原因)

当前技术局限

尽管LPLB提供了先进的动态优化能力,但仍存在以下技术挑战:

- 非线性计算成本忽略:当前规划器仅平衡Token总量,未充分考虑分组矩阵乘法时间成本的非线性特性,可能影响极端情况下的性能表现

- 求解延迟影响:节点内优化约需100微秒(跨节点时间更长),对于极小批次训练,此延迟可能产生显著影响

- 极端不均衡场景:在全局负载极度不均衡的情况下,LPLB表现可能不及EPLB,主要源于冗余专家分配策略的差异

典型拓扑结构配置

LPLB支持通过修改r2o矩阵定义专家副本分布模式,主要拓扑类型包括:

- 立方体结构:在GPU子集上复制专家,构建含对角边的立方体图。要求每个GPU至少配备2个专家,适用于8GPU专家并行子组内的负载平衡,且保持跨节点通信效率

- 超立方体结构:类似立方体但不含对角边,需要16个GPU支持,适合跨16GPU的专家并行场景

- 环面结构:在同一节点内邻接GPU上复制专家,在相邻节点GPU上创建另一副本,构建环面图。虽然对全局平衡有效,但因涉及更多节点内通信,效率通常低于立方体结构

技术价值与展望

DeepSeek开源的LPLB库本质上致力于解决大模型训练中的"木桶效应"——训练速度受限于负载最重的GPU单元。其创新性体现在引入线性规划数学工具进行实时最优分配计算,并利用底层NVSHMEM技术突破通信瓶颈。

对于专注于MoE架构训练加速研究的开发者而言,这一实现提供了极具参考价值的技术范例。详细安装指南和测试方法请访问原代码库获取。

想获取更多AI最新资讯与智能工具推荐, 欢迎访问 👉 AI Tools Nav ——优质的 AI导航平台 与 AI学习社区

本文来源:机器之心

原文链接:https://www.jiqizhixin.com/articles/ef37cb3f-8fb7-40cc-b407-d681534febaa