HumanLift技术:单张图片实现高保真3D数字人多视角重建

HumanLift技术:单张图片实现高保真3D数字人多视角重建

在当今数字化时代,创建逼真的三维数字人模型已成为影视制作、游戏开发和虚拟现实等领域的核心技术需求。这种技术能够为用户带来沉浸式的视觉体验,推动数字内容创作进入全新阶段。

虽然现有技术在多视角图像重建方面已取得显著进步,但从单一图像生成高质量三维人体模型仍面临诸多技术瓶颈。其中最大的挑战在于如何平衡三维空间的一致性与原始图像的保真度,同时精确还原服装纹理和面部细节等关键特征。

近期,来自中国科学院计算技术研究所、香港科技大学和卡迪夫大学的科研团队联合研发了一项突破性技术——HumanLift。这项创新方法能够基于单张参考图像重建高斯网数字人全身模型,相关研究成果已获SIGGRAPH ASIA 2025收录。

- 项目主页:http://geometrylearning.com/HumanLift/

HumanLift技术融合了三维视频扩散模型与面部增强算法,用户仅需提供单张人体照片,即可生成高保真度的三维数字人。该技术不仅能准确预测不同视角下的人物外观和服饰细节,还能确保多视角间的高度一致性,同时忠实保留原始图像的特征信息。

技术发展背景

早期单图重建技术主要分为显式和隐式两种路径。显式方法依赖参数化模板,虽能估计基础人体形态,但难以适应复杂服装场景;隐式方法通过函数描述几何结构,提升了重建质量,却面临计算效率低和纹理真实感不足的困境。

随着Stable Diffusion等生成模型和神经辐射场技术的快速发展,二维与三维空间的转换效率得到显著提升。然而,由于三维人体数据稀缺以及姿态、服饰的复杂性,将这些技术应用于高真实感人体建模仍存在诸多障碍。

现有方法尝试通过文本信息和扩散模型进行建模,但受限于文本描述的模糊性,难以精确还原服装细节。多视图生成技术的出现为这一问题提供了新的解决思路,但缺乏三维先验导致视角一致性不足,特别是面部细节的重建效果仍有待提升。

核心技术原理

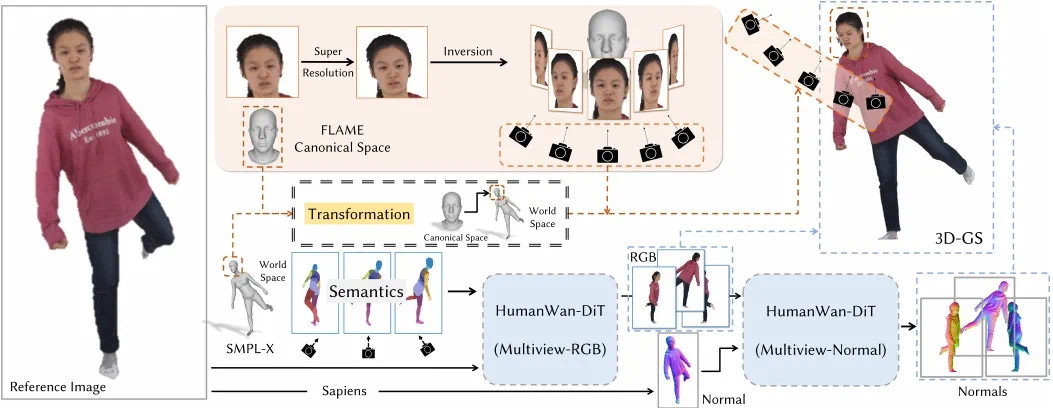

HumanLift采用两阶段处理流程,旨在从单张输入图像创建具备逼真外观和精细细节的3D数字形象。

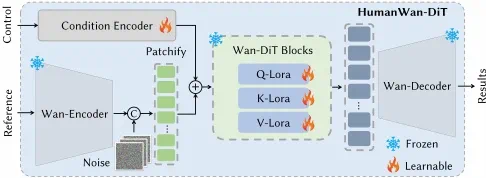

第一阶段:多视角图像生成

该阶段基于Wan2.1视频生成模型构建,通过引入三维人体先验信息,专门设计了HumanWan-DiT(RGB)和HumanWan-DiT(Normal)两个优化模型。这些模型利用SMPL-X的多视角语义图像作为三维引导条件,采用低秩适应技术进行高效参数微调,确保生成图像的多视角一致性和几何细节精度。

第二阶段:3D-GS模型重建

此阶段利用生成的多视角图像重建人体的3D高斯泼溅表示。通过专门的面部增强模块生成高质量多视角面部图像,并基于高斯网表示优化三维高斯球参数。关键技术突破在于动态调整面部相机姿态,确保与头部三维高斯球始终保持空间一致性。

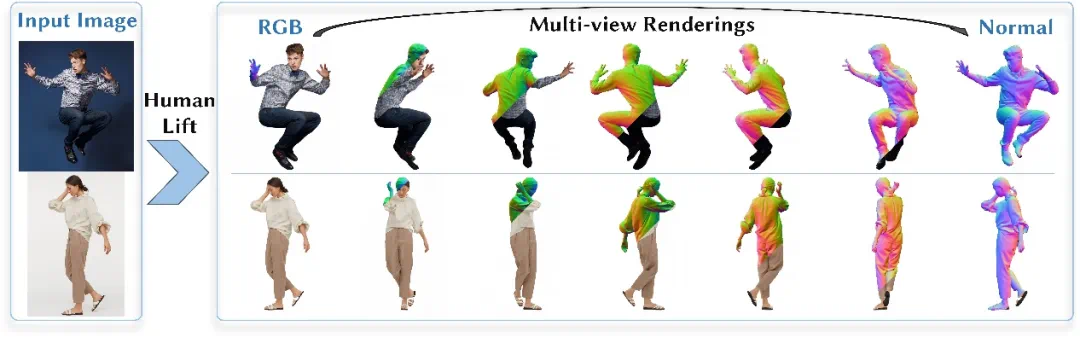

实际应用效果

在实际测试中,HumanLift展现出卓越的泛化能力,能够处理各种服饰风格和拍摄环境的人物图像。生成的多视角RGB图像具备照片级真实感,法向图精准反映服饰几何细节,整体空间一致性表现优异。

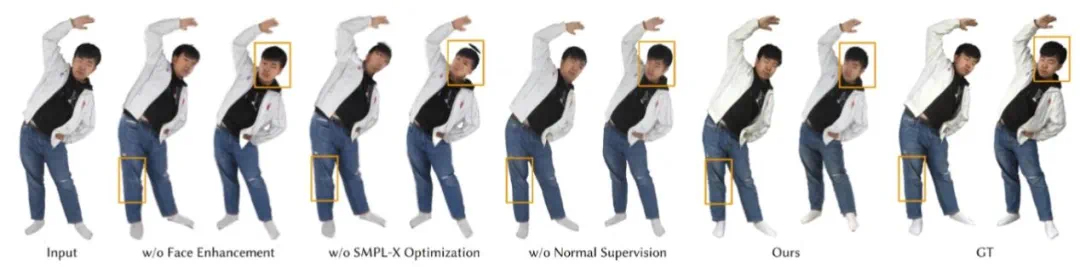

消融实验证实了各技术模块的重要性:面部增强模块显著提升面部细节质量;SMPL-X优化模块确保姿态匹配精度;法线监督模块有效保留衣物细节。这些组件的协同工作构成了HumanLift技术的核心竞争力。

技术展望

随着生成式人工智能的快速发展,单图数字人重建技术正迎来新的突破。HumanLift通过创新的三维扩散先验和面部增强技术,成功解决了传统方法在真实感、复杂服饰和面部一致性方面的技术难题,为数字内容创作提供了更加便捷高效的解决方案。

想获取更多AI最新资讯与智能工具推荐, 欢迎访问 👉 AI Tools Nav ——优质的 AI导航平台 与 AI学习社区

本文来源:机器之心

原文链接:https://www.jiqizhixin.com/articles/4b1675f2-3f5c-4dba-b7ff-b6748c420880